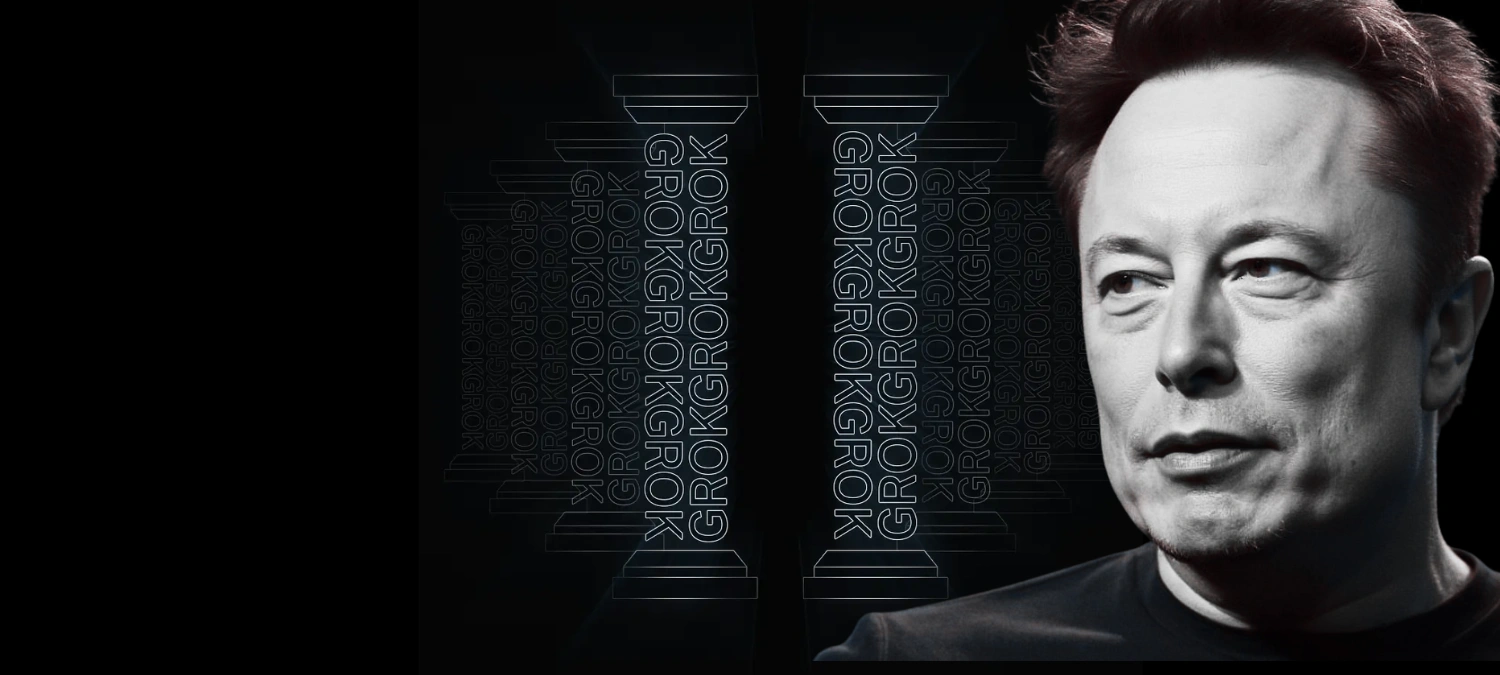

Début décembre 2024, xAI, l’entreprise d’Elon Musk, a lancé Grok 2, une intelligence artificielle générative révolutionnaire. Sa particularité ? Elle ne connaît presque aucune limite. Contrairement à ses concurrents, Grok 2 peut créer des images ultraréalistes sur n’importe quel sujet : personnalités publiques, événements historiques ou scènes fictives. Pour certains, elle représente un bond technologique majeur. Pour d’autres, elle incarne un danger existentiel. Grok 2 menace de déstabiliser les fondements mêmes de nos sociétés : la vérité, la démocratie, l’économie, et notre mémoire collective. Associée au réseau social X, l’IA démocratise la désinformation à une échelle sans précédent. Dans cet article, nous analysons ses impacts et explorons les moyens d’y faire face.

Une société post-vérité ?

Avec Grok 2, la réalité devient malléable. En quelques secondes, l’IA génère des images si convaincantes qu’elles effacent la frontière entre le vrai et le faux. Par exemple, imaginez une photo montrant Emmanuel Macron embrassant Marine Le Pen ou des clichés compromettants de chefs d’État. Ces créations pourraient être utilisées comme des « preuves » visuelles, alors qu’elles sont totalement fictives.

Historiquement, les images ont toujours été synonymes de vérité. Elles incarnaient des faits tangibles. Grok 2 détruit cette certitude. Ce glissement risque de renforcer les bulles cognitives : chaque individu se nourrit désormais d’images confortant ses propres croyances. Les deepfakes avaient amorcé ce phénomène. Grok 2, gratuite et accessible, le pousse à l’extrême.

Que faire ? Comment discerner la vérité dans un océan de faux visuels ? Des solutions technologiques émergent : algorithmes de détection, certification par blockchain ou outils d’analyse avancée. Cependant, la clé reste sociétale. Il devient urgent de développer l’esprit critique et d’éduquer à la littératie numérique. Sans cela, nous risquons de sombrer dans un relativisme où « tout se vaut« .

Un outil qui menace la démocratie

Grok 2 arrive à un moment charnière. Partout, la polarisation politique s’accentue. Dans ce contexte, l’IA devient une arme redoutable. Elle peut fabriquer des scénarios fictifs : un politicien en pleine réunion secrète ou pris dans une affaire embarrassante. Une image virale suffit à influencer des millions de votants.

Ce n’est pas de la science-fiction. Lors des dernières élections roumaines, TikTok a été inondé de fausses informations. Les soupçons de manipulation et d’ingérence sont si forts que l’élection présidentielle roumaine a tout simplement été annulée. Grok 2 rend ces pratiques encore plus accessibles. Avec peu de moyens, des groupes malveillants peuvent manipuler l’opinion publique. Son absence de filtres facilite la production rapide et massive de contenus trompeurs.

Les solutions ? Certaines plateformes pourraient interdire la diffusion d’images non vérifiées. En parallèle, des lois internationales devraient encadrer les contenus générés par IA. Ces mesures deviennent indispensables. Sans elles, Grok 2 risque de saper les piliers de la démocratie.

Quand la désinformation devient une arme économique

Les menaces de Grok 2 ne s’arrêtent pas à la sphère politique. L’économie devient aussi une cible potentielle. Une image fabriquée montrant le PDG d’une entreprise dans une situation compromettante pourrait provoquer une chute brutale de son cours en Bourse. Sur les réseaux, quelques heures suffisent pour causer des dégâts irréversibles.

Ces scénarios ne relèvent pas de l’imaginaire. Des acteurs malveillants – entreprises rivales, activistes ou États hostiles – pourraient exploiter Grok 2 pour déstabiliser des marchés ou des entreprises stratégiques. Les conséquences ? Des pertes financières massives et une perte de confiance.

Pour contrer ces abus, il est essentiel de déployer des systèmes de vérification d’authenticité. Par exemple, des filigranes invisibles ou des solutions de traçabilité basées sur l’IA. Ces outils devront être soutenus par des réglementations internationales pour garantir leur efficacité.

La fin des « preuves visuelles » ?

Pendant des décennies, les images et vidéos ont servi de preuves dans les enquêtes judiciaires, journalistiques et scientifiques. Grok 2 remet en question cette fonction clé. Ses créations, d’un réalisme troublant, rendent les preuves visuelles presque inutilisables. Comment distinguer une photo authentique d’un faux ?

Dans les tribunaux, cette évolution pourrait rendre les affaires criminelles plus complexes. Les médias, eux, devront vérifier leurs contenus avec une rigueur sans précédent. Cette perte de confiance fragilise également la mémoire collective : les archives visuelles deviennent suspectes.

Pour répondre à ce défi, des technologies comme la blockchain pourraient permettre de certifier les images dès leur création. Mais cela ne suffira pas. Nous devons aussi apprendre à aborder les images avec prudence et à cultiver une approche critique.

Une régulation éthique globale

L’émergence de Grok 2 met en lumière un vide réglementaire. Actuellement, aucune législation mondiale ne contrôle l’usage des IA génératives. Cette absence favorise les abus et entrave la mise en place d’un cadre éthique.

Le problème ? Les priorités diffèrent selon les pays. Certains valorisent la liberté d’expression. D’autres privilégient le contrôle des technologies. Cette divergence complique la création d’un consensus international. Pourtant, une régulation globale est indispensable. Une autorité internationale pourrait superviser ces outils et définir des normes éthiques.

En parallèle, une course technologique s’engage. Les entreprises rivalisent pour développer des IA capables de détecter et de neutraliser les deepfakes. L’avenir de Grok 2 dépendra de notre capacité à équilibrer liberté d’innovation et responsabilité sociétale.

Repenser la vérité à l’ère des IA : rétrospectivement, c’était inévitable

Grok 2 marque une avancée spectaculaire (inévitable ?) dans le domaine des IA. Mais son impact dépasse la simple prouesse technologique. Désinformation, manipulation politique, sabotage économique : les défis qu’elle pose sont nombreux et complexes. Pourtant, ces menaces ne sont pas insurmontables.

En combinant innovation technologique, régulation et éducation citoyenne, il reste possible d’atténuer les dérives. Il s’agit surtout de réinventer un monde capable de tourner rond avec (malgré ?) l’existence de ces technologies. Grok 2 nous oblige à repenser nos rapports à la vérité, aux images et à l’information. Si nous relevons ce défi, l’IA pourra rester un outil au service du bien commun.