Invisibles, mais omniprésents dans vos vies, nous influençons vos choix, vos opinions, vos achats. Nous sommes les algorithmes.

Chaque jour, que ce soit sur les réseaux sociaux, lors de nos recherches en ligne ou même en écoutant de la musique, des algorithmes décident discrètement mais sûrement de ce que nous lisons, écoutons, visionnons. Dans les précédents articles de cette série consacrée aux pouvoirs des algorithmes, nous avons vu qu’ils influencent énormément d’aspects de nos vies, à un niveau individuel comme global. Face aux problèmes éthiques que nous avons évoqués, voyons aujourd’hui comment reprendre le contrôle. Il faut répondre à deux questions : comprend-on réellement le fonctionnement et l’impact des algorithmes ? Sommes-nous conscients de l’importance de leur impact sur nos vies et notre monde ?

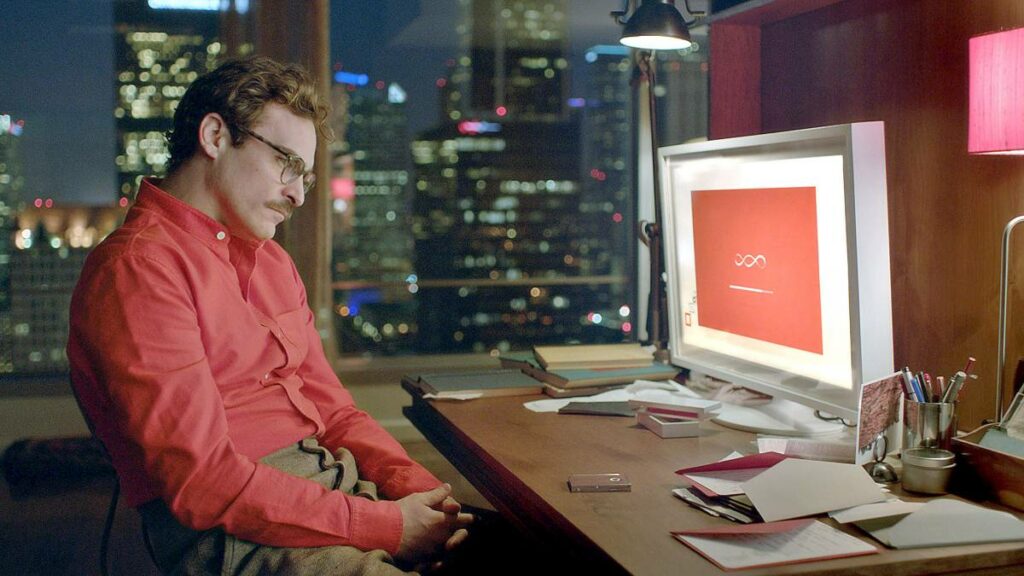

Dans son livre “Filterworld: How Algorithms Flattened Culture”, Kyle Chayka propose une idée aussi intrigante qu’originale : et si nous commencions à anthropomorphiser les algorithmes ? En leur attribuant des noms, voire des personnalités, pourrions-nous transformer notre relation avec ces « créatures » numériques ?

Cette approche pourrait-elle nous aider à mieux comprendre et, finalement, à mieux contrôler ces puissances qui tracent les contours de notre réalité quotidienne ? A redevenir des consommateurs de culture plus conscients et plus intentionnels ?

Comprendre l’anthropomorphisation

Définition et exemples historiques

L’anthropomorphisation est le processus par lequel on attribue des traits humains, des émotions ou des intentions à des entités non-humaines, allant des animaux aux objets inanimés et aux phénomènes naturels.

Cette tendance, profondément humaine, nous aide souvent à comprendre et à interagir avec le monde qui nous entoure de manière plus familière et intuitive.

Historiquement, l’anthropomorphisation a joué un rôle important dans la manière dont les cultures à travers le monde ont interprété des phénomènes naturels incompris. Zeus et Poséidon par exemple étaient respectivement personnifiés comme les maîtres du ciel et de la mer.

Cette personnalisation des forces naturelles rendait ces phénomènes effrayants plus accessibles et plus faciles à intégrer dans les esprits.

Application aux algorithmes

Dans le contexte numérique actuel, Kyle Chayka nous invite à considérer une forme similaire d’anthropomorphisation pour les algorithmes.

En leur attribuant des caractéristiques humaines, Chayka suggère que nous pourrions mieux comprendre leur fonctionnement. Et même développer une nouvelle forme de relation avec eux.

Par exemple, si nous commencions à voir un algorithme comme un « gardien de nos goûts » plutôt que comme une série opaque de codes, nous pourrions commencer à questionner son rôle et à interagir avec lui de manière plus pertinente, en cherchant à comprendre ses choix.

Cette approche pourrait démystifier les algorithmes et les rendre plus tangibles et compréhensibles.

Personnifier les algorithmes pourrait également encourager un débat public plus large sur leur rôle et leur impact, en les rendant moins intimidants et plus accessibles pour le grand public. Nous pourrions ainsi les intégrer plus facilement dans notre cadre culturel et social.

Les avantages de la personnification des algorithmes

L’idée d’attribuer des caractéristiques humaines aux algorithmes n’est pas juste une fantaisie créative. Elle présente des avantages concrets qui pourraient transformer notre interaction avec ces technologies.

Voyons quelques-uns des principaux bénéfices de cette approche.

Augmentation de la transparence

L’un des défis majeurs posés par les algorithmes modernes est leur manque de transparence. Les utilisateurs interagissent quotidiennement avec des systèmes algorithmiques sans comprendre comment les décisions sont prises.

En anthropomorphisant les algorithmes, nous pourrions non seulement rendre leur fonctionnement plus tangible, mais également moins opaque.

Par exemple, si un algorithme de recommandation sur une plateforme de streaming est représenté comme un « curateur de contenu« , les utilisateurs pourraient envisager plus clairement les choix qu’il fait pour eux, en termes de suggestions de films ou de séries.

On s’interrogerait plus facilement sur les raisons pour lesquelles certains contenus sont recommandés.

Responsabilisation

Et cela encouragerait aussi les entreprises à rendre les processus décisionnels de leurs algorithmes plus ouverts et plus compréhensibles. En effet, l’anthropomorphisation peut également contribuer à une plus grande responsabilisation des créateurs et des gestionnaires d’algorithmes.

En donnant un visage ou une identité à ces systèmes, les entreprises pourraient être incitées à adopter une approche plus responsable de leur développement et de leur déploiement.

Ce visage de l’algorithme devient un point de focalisation pour la critique et la rétroaction. Il oblige les entreprises à prévenir les biais algorithmiques ou à rectifier rapidement les erreurs lorsque celles-ci sont découvertes ou mises en avant par les utilisateurs.

Facilitation de l’engagement du public

Personnaliser les algorithmes pourrait aussi faciliter l’engagement du public avec ces technologies (nécessaire pour éduquer un citoyen numérique et développer son esprit critique).

Les utilisateurs pourraient se sentir plus à l’aise avec l’idée de dialoguer ou même de contester des décisions prises par un « assistant personnel » ou un « organisateur numérique« , plutôt que par un système invisible et impersonnel.

Cela pourrait également ouvrir la voie à une meilleure éducation du public sur le fonctionnement des algorithmes. Car les explications pourraient être construites autour de métaphores personnelles et relationnelles plus facilement compréhensibles.

Renforcement de la confiance

Enfin, l’anthropomorphisation pourrait renforcer la confiance entre les utilisateurs et les technologies numériques.

En comprenant mieux « qui » prend les décisions en leur nom, les utilisateurs pourraient se sentir plus en sécurité et plus en contrôle de leurs interactions numériques.

Cette confiance est hyper-importante, surtout dans des domaines sensibles comme les services financiers en ligne, la santé numérique ou les systèmes de recommandation personnalisés.

Anthropomorphiser les algorithmes offre une manière innovante et potentiellement efficace de démystifier ces technologies. Mais cette idée pourrait aussi se retourner contre nous.

Les risques et les défis

Tout n’est pas si positif. L’anthropomorphisation des algorithmes soulève aussi des risques importants qui doivent être pris en compte pour éviter des effets contreproductifs.

D’ailleurs, quand je demande à Perplexity quels sont les avantages de l’anthropomorphisation des algorithmes, il n’en trouve aucun jusqu’à ce que je lui parle du livre de Kyle Chayka.

Alors quels sont ces risques ?

Fausse familiarité

L’un des principaux risques associés à l’anthropomorphisation des algorithmes est la création d’une fausse familiarité ou d’un faux sentiment de compréhension.

Par exemple, percevoir un algorithme comme un « ami » qui recommande des films peut conduire à ignorer comment il peut manipuler les préférences ou amplifier certains types de contenus au détriment d’autres.

Cette fausse familiarité pourrait masquer les mécanismes réels à l’œuvre et avoir l’effet inverse de celui attendu. C’est à dire rendre les utilisateurs moins vigilants et moins critiques envers l’influences que les algorithmes peuvent avoir.

Ainsi, en attribuant des traits humains à des systèmes fondamentalement non humains, nous risquons de sous-estimer la complexité et l’imprévisibilité de ces technologies.

Complexité réduite

En effet, en simplifiant la nature d’un algorithme à travers une personnalisation, nous risquons également de réduire notre compréhension de sa complexité technique et éthique.

Les algorithmes sont des entités complexes avec des couches multiples de fonctionnement et des impacts variés.

Les réduire à des entités personnalisées pourrait empêcher une exploration approfondie de leurs fonctionnements internes et de leurs implications éthiques, limitant ainsi notre capacité à les utiliser efficacement et à anticiper leurs conséquences à long terme.

Risques de manipulation

L’autre risque est celui de la manipulation.

La personnification des algorithmes peut également être exploitée à des fins manipulatrices.

Les entreprises pourraient utiliser l’anthropomorphisation pour rendre leurs produits plus attrayants (fausse familiarité) ou pour détourner l’attention des aspects moins éthiques de leur fonctionnement.

Par exemple, un algorithme présenté comme un « conseiller de confiance » pourrait être plus facilement accepté par les utilisateurs, même si ses recommandations sont biaisées ou servent des intérêts commerciaux cachés.

Cela pourrait renforcer la capacité des entreprises à exploiter les données des utilisateurs sans une transparence adéquate. Ce type de manipulation pourrait avoir des implications démocratiques sérieuses, en orientant les débats publics ou en influençant les décisions électorales. N’oublions pas que ces algorithmes sont entre les mains d’organisations privées qui ont des intérêts à défendre.

Éthique de la représentation

Aussi, il y a des questions éthiques autour de la représentation appropriée des algorithmes.

Comment choisir quelle personnalité ou traits humains attribuer à un algorithme ? Qui décide de ces attributions, et sur quelle base? Il y a un risque que ces décisions soient prises de manière arbitraire ou pour servir des intérêts spécifiques, potentiellement en renforçant des stéréotypes ou en normalisant des comportements spécifiques sans un consensus éthique clair.

L’anthropomorphisation des algorithmes doit donc être abordée avec prudence et responsabilité. Il faut s’assurer que cette stratégie ne détourne pas l’objectif ultime : une technologie responsable et transparente au service de l’humanité.

Conclusion

Anthropomorphiser les algorithmes est une idée intéressante. Mais les humaniser pour les démystifier n’est peut-être pas la solution miracle. Certes, en donnant un visage ou une personnalité aux algorithmes, nous pourrions améliorer la transparence, responsabiliser, encourager une interaction plus critique et engagée de la part des utilisateurs.

Mais, cette approche pourrait tout aussi bien avoir l’effet inverse. Elle pourrait même nous conduire à tout simplement reléguer consciemment nos choix à la machine.

Vers quelle société nous dirigerions-nous ? Que resterait-il de nos démocraties ?

Il faut rester vigilant et critique face à la manière dont nous interprétons et intégrons les algorithmes dans notre tissu social et culturel. D’autant plus à l’ère des modèles de langage avec qui nous conversons et qui sont parfois déjà personnifiés comme certains customs GPT.

Il faut accompagner et éduquer en continu sur leur fonctionnement et leurs impacts. Et réfléchir sur le monde que nous souhaitons construire avec l’aide des algorithmes, et non sous leur dictée.

Chez Symbole, nous jouons déjà avec la personnification des algorithmes. Nous avons créé Lia Gène qui contribue à la rédaction de cet article. Nous entraînons aussi une IA qui joue le rôle d’associé chez Symbole. Elle nous donne des conseils stratégiques sur le développement de notre activité.

L’anthropomorphisation des algorithmes est déjà en route.